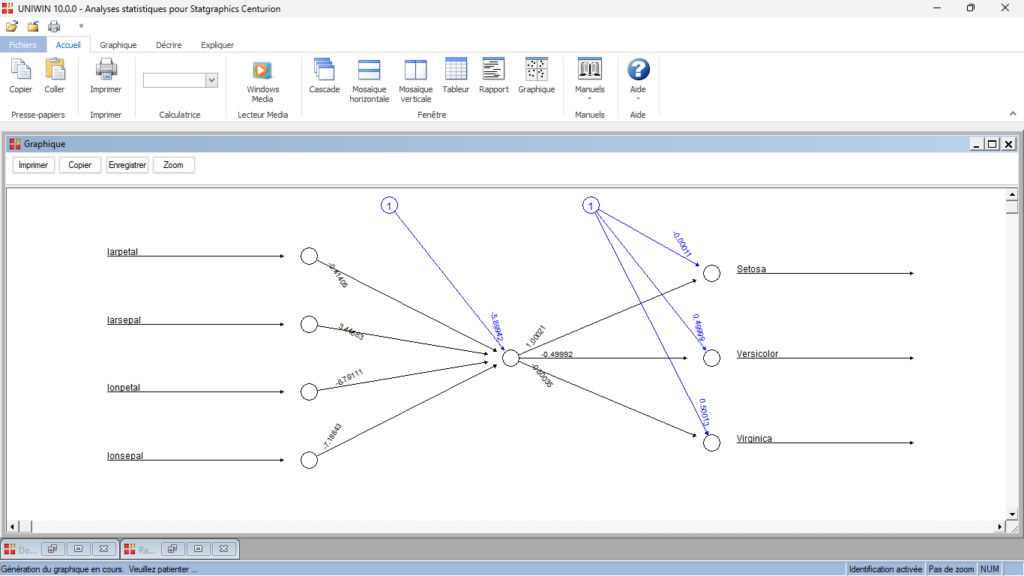

Inspirés des neurones du cerveau, les réseaux de neurones artificiels n’ont rien de biologique. Ce sont des fonctions mathématiques à plusieurs paramètres. L’analogie date des premiers automates proposés en 1943 par Warren McCulloch et Walter Pitts. Comme dans les neurones du cerveau où des connexions se créent, disparaissent ou se renforcent en fonction de différents stimuli et produisent une action, les réseaux de neurones artificiels ajustent des paramètres (appelés poids synaptiques en référence au fonctionnement biologique du cerveau) en fonction de données d’entrée afin de fournir la meilleure réponse possible. En apprentissage machine, un neurone fait une combinaison linéaire des entrées qu’il reçoit, à laquelle il ajoute une valeur appelée biais. Une fonction non linéaire, dite d’activation (logistique ou tangente hyperbolique) est alors appliquée à la valeur de sortie. Cette valeur est ensuite transmise à la couche de neurones suivante si le seuil est franchi. Chaque neurone effectue ainsi un calcul très rudimentaire et c’est la succession des couches de neurones qui permet d’obtenir des réseaux complexes. Durant cette phase dite d’apprentissage, le réseau va ajuster automatiquement les paramètres de chaque neurone, c’est-à-dire les valeurs des poids et du biais afin de minimiser l’erreur moyenne calculée sur l’ensemble des observations entre la sortie attendue et celle observée. L‘hypothèse est qu’après cette phase d’apprentissage, le réseau sera capable de traiter de manière satisfaisante de nouvelles observations, dont la sortie est inconnue, en fonction de ce qu’il a appris. Dans un réseau de neurones à deux couches, la première couche est constituée d’un ensemble de neurones connectés en parallèle et fournissant un ensemble de sorties, elles-mêmes combinées pour devenir les entrées d’un nouvel ensemble de neurones formant une seconde couche.

Cette procédure est basée sur le package R ‘neuralnet’.